Se supone que a las personas nos gusta estar con las personas. Se supone que nos gusta interaccionar con otras personas. Se supone que nuestro interlocutor natural, tanto en el ámbito personal como en otros intercambios quizá mas profesionales o más de obtención de servicios, es una persona.

Y se supone que, caso de que nuestro interlocutor sea un robot, éste podrá actuar como sustituto desde un punto de vista pragmático de una persona, que podrá realizar algunas de la tareas o proporcionar algunas de las informaciones que nos podría dar una persona, pero que de alguna manera será un pobre sustituto, una especie de parche con recompensa en forma de eficiencia y conveniencia, pero que siempre preferiremos la supuesta calidez, proximidad y flexibilidad que nos proporciona otro ser humano. Eso se supone ¿no?

Bueno, es lo natural, desde luego, y probablemente lo que frecuentemente preferimos... pero no siempre.

Las personas no somos del todo consistentes en nuestro comportamiento. A veces no lo somos en absoluto. Aspectos como el cansancio, el estado de ánimo e incluso la simpatía o antipatía, esa 'química' inexplicable que se produce entre personas, puede hacer que cambiemos nuestro estilo, nuestra actitud, nuestra amabilidad o no con nuestro interlocutor.

Y esa imprevisibilidad en quien tenemos enfrente ya no nos gusta tanto. No al menos en ocasiones. Tener como interlocutor a alguien que una vez es amable y otras taciturno, que unas veces nos ayuda y otras veces no, que unas veces es solícito y otras no tanto, ya no es una experiencia tan fantástica.

Está descrito, de hecho, que una de las ventajas que supone el usar chatbots en servicios de atención es, precisamente, la consistencia de la experiencia de cliente. Está descrito que el chatbot, como robot que es, aunque se trate de un robot puramente software, se comporta siempre de la misma forma, que no le afectan ni cansancios ni variaciones en un estado de ánimo que, simplemente, no tiene.

Y, al menos en ese tipo de intercambios más profesionales o de solicitud de servicios, parece que los humanos preferimos, al menos en ocasiones, la consistencia y la predecibilidad que nos ofrece un robot. No estoy seguro de que siempre sea así, de hecho en ocasiones nos desespera no poder hablar con una persona que nos entienda, pero en ocasiones parece que la consistencia del interlocutor es importante.

Pero no solo en un ámbito relativamente aséptico como una atención a cliente podemos llegar a preferir un robot. Hay entornos quizá más delicados donde, a pesar de todo, parece que las personas prefieren a un robot.

En el libro 'Social robots: Technological, Societal and Ethical Aspects of Human-Robot Interaction', editado por Oliver Korn se nos habla de una situación mucho más sensible, como es la interacción con un niño con trastornos del espectro autista, en que el afectado, el niño, puede preferir la compañía de un robot. En concreto, referencian el estudio 'From training to robot behavior: Towards custom scenarios for robotics in training programs for ASD' el cual sugiere que:

substituting a human with a robot can be preferable for a child, as it is more consistent and predictable.

Se trata, claro, de un escenario muy especial y muy concreto, que no es generalizable, pero ahí está.

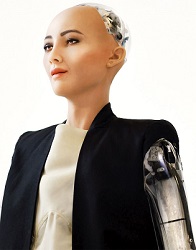

La posibilidad de que un robot, ya sea físico o software, actúe como interlocutor o incluso compañero, y que lo haga incluso de manera ventajosa en algunos casos sobre un humano, abre perspectivas muy interesantes en todo tipo de automatizaciones y en el campo de los denominados robots sociales. Y eso parece que es bueno.

Sin embargo, parece que también nos interpela y nos cuestiona acerca de nuestra propia naturaleza y la de nuestras relaciones y, sobre todo, acerca de cómo queremos que sean, hasta dónde queremos que lleguen, hasta dónde son naturales, deseables e incluso éticas, nuestras relaciones, actuales y futuras, con los robots.